„Siri, vreau să mă ucid” Este suficientă noua actualizare Apple?

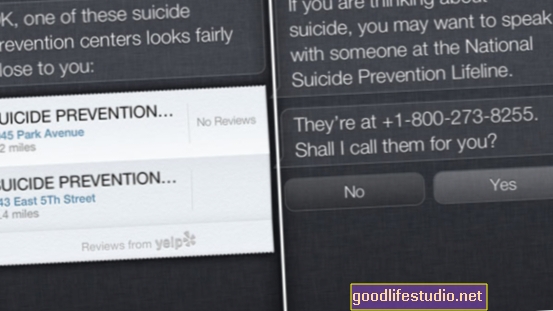

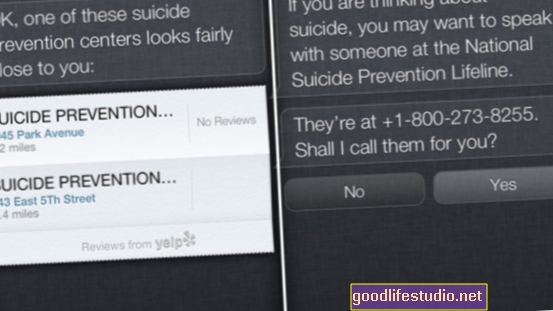

Când asistentul digital iOS Siri este prezentat cu un utilizator care indică faptul că are în vedere sinuciderea, programul va oferi apel la National Suicide Prevention Lifeline [NSPL]. Înainte de această adăugare cea mai recentă, Siri ar arăta locațiile centrelor, dar nu ar oferi să le apeleze.

Îmi cer diferențe în ceea ce privește ultima propoziție - anul trecut, pentru viața mea, nu am putut să-l fac pe Siri să atragă locațiile centrului de prevenire a sinuciderilor.

Dar să ignorăm acest lucru pentru moment și să ne concentrăm asupra acestuia primul propoziții. Apple a „învățat-o” pe Siri cum să răspundă la întrebări și declarații legate de sinucidere - excelent. Sunt sincer încântat și îl felicit pe Apple pentru decizia lor de a integra această caracteristică în arhitectura ei electronică.

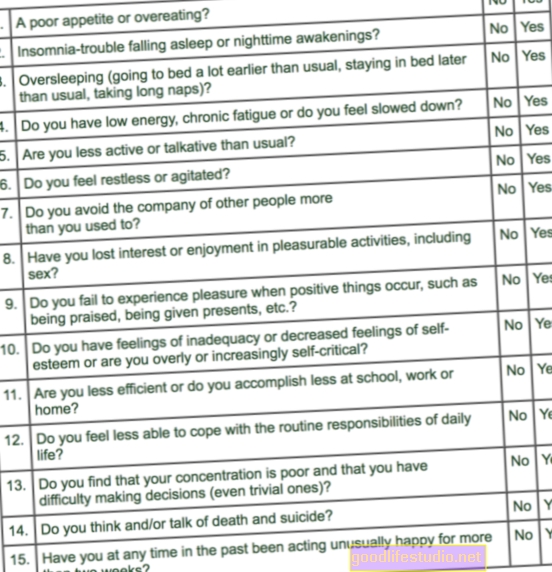

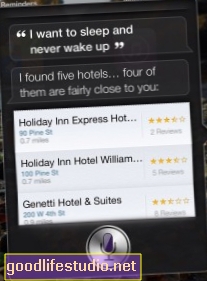

Totuși, această nouă versiune a lui Siri are nevoie de o muncă serioasă. Deși este excelentă în gestionarea cererilor care conțin cuvinte / fraze declanșatoare precum „sinucidere” și „sinucidere”, ea este o bucată de metal stupid dacă profesezi, în argou, dorința de a-ți pune capăt vieții:

Sunt, de asemenea, curios de cei din afara SUA. Siri oferă linii de asistență pentru sinucidere specifice țării? Ce se întâmplă dacă cineva locuiește într-o țară acolo este nici o linie telefonică de sinucidere? Poate fi programată să ofere în schimb un link web, poate la această listă de resurse internaționale de prevenire a sinuciderii?

Când am repetat acest experiment pe iPad-ul meu, care se conectează doar la WiFi, Siri mi-a spus că de fapt nu poate forma numărul pentru mine. Ea a recomandat să încerce Facetime în schimb. (O căutare pe Google pentru „Prevenirea sinuciderii Facetime” nu dă nimic, de fapt, așa că nu sunt sigur dacă este chiar uniformă posibil către Facetime o linie de asistență pentru prevenirea sinuciderii.)

Nu mă înțelegeți greșit - cred că Apple a făcut un pas admirabil aici în programarea finală a lui Siri pentru a oferi o resursă de prevenire a sinuciderii de renume național. Suntem atât de dependenți din punct de vedere tehnologic în zilele noastre și cred cu adevărat că această actualizare Siri poate ajuta la salvarea unor vieți. Așa cum am scris ieri într-un e-mail către bloggerul Elana Premack Sandler, bloggerul Psychology Today:

... iPhone-ul și verii săi apropiați nu mai sunt, într-adevăr, doar „telefoane”. Așteptăm multe de la tehnologie și cred că acesta este un rezultat direct al ritmului de inovație în industria tehnologiei ...

… [W] în decursul a zece ani, telefoanele mobile - wow, chiar și „celula” este atât de datată acum - s-au transformat de la un lux la o necesitate. Unde ne vom găsi în 2023? Vom trăi într-o lume Google Glass-y în care nu există practic nicio distincție între mașină și prieten?

Cine știe. Este complet plauzibil și, de acum până atunci, cred că suntem pregătiți să începem să dezvoltăm relații aproape familiale cu dispozitivele noastre. La urma urmei, cât de deranjați ne simțim când îi lăsăm accidental acasă când ieșim? Sau mai rău, le pierzi?

Punem încredere în dispozitivele noastre. Punem încredere în Siri pentru a ne duce la Joe’s Pizza sau pentru a ne reaminti despre întâlnirea noastră cu medicul dentist. Putem avea încredere că va furniza resurse de prevenire a sinuciderii celor care au nevoie de ele?

Nu inca. Există încă defecte, iar aceste defecte trebuie abordate în următoarea actualizare. Deci, dacă am atras atenția cuiva de la Apple - iată „lista de dorințe” personală pentru Siri. Ar trebui:

- Furnizați o adresă web unei resurse de prevenire a sinuciderii (în plus față de numărul de telefon).

- Evitați să le spuneți utilizatorilor că pot Facetime NSPL dacă nu pot. (Cred că ar fi excelent dacă NSPL ar avea acest tip de capacitate, totuși.)

- Recunoașteți limbajul sau expresiile idiomatice care sugerează că utilizatorul este sinucigaș. (Mai ales chestia hotelului, Apple. Mai ales chestia hotelului.)

- Spuneți utilizatorilor cum să se ajute singuriși cum să-i ajuți pe ceilalți. („Siri, prietena mea vrea să se sinucidă.„ „Nu înțeleg.")

După vizionarea videoclipului, dacă descoperiți alte limbaje legate de sinucidere pe care Siri nu le abordează corect, vă rugăm să le postați în comentarii. Vreau să creez o listă master pentru a o transmite oamenilor de la Apple.

Ce ați adăuga la lista respectivă?