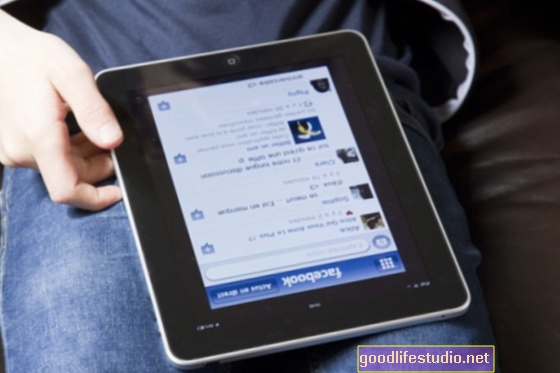

Documente secrete: Facebook pare să pună funcții, profitul este mai mare decât siguranța utilizatorilor

Facebook, gigantul în vârstă de 13 ani, cu 1,23 miliarde de utilizatori activi, generează venituri de peste 8 miliarde de dolari pe trimestru - din care 3 miliarde de dolari reprezintă venitul net (de exemplu, profit).

Dar cu atât de mulți utilizatori, Facebook pare să fi retrogradat siguranța utilizatorilor într-o preocupare secundară. Până la începutul acestui an, Facebook angaja doar 4.500 de persoane pentru a examina conținutul. Ceea ce sună ca o mulțime de oameni până când îți dai seama că acei 1,23 miliarde de utilizatori activi partajează miliarde de bucăți de conținut în fiecare zi, cu milioane de reclamații ale utilizatorilor despre conținutul Facebook depuse în fiecare zi.

Are Facebook o problemă serioasă de siguranță a utilizatorilor? Un tocmai publicat paznic revizuirea documentelor interne secrete sugerează că problema sa este scăpată de sub control.

Facebook a recunoscut că are un fel de problemă atunci când la începutul acestui an a fost de acord să își dubleze aproape personalul de revizuire - la 7.500 - pe fondul acuzațiilor că compania pur și simplu nu face (sau poate îi pasă?) Suficient atunci când conținutul potențial dăunător este traficat pe platforma sa . Nu vă dublați personalul de moderator dacă totul este dory.

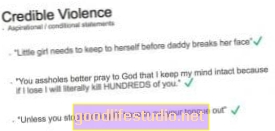

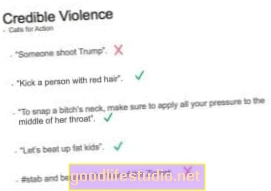

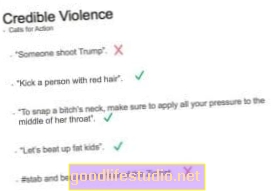

Acum, (UK) Guardian a publicat detalii uimitoare ale liniilor directoare de moderare a conținutului Facebook, selectate din peste 100 de manuale secrete, de instruire internă și documentație. Este puțin deranjant că toate aceste lucruri importante nu se află într-un singur manual dat moderatorilor Facebook atunci când sunt angajați.În schimb, pare a fi o abordare fracționată a politicii, rezultând în ceea ce pare a fi informații conflictuale, moderare inegală și foarte puțină fiabilitate în modul în care politicile sale de moderare funcționează de fapt în lumea reală.

„Facebook nu poate păstra controlul asupra conținutului său”, a spus o sursă. „A crescut prea mult, prea repede.”

Se spune că mulți moderatori au îngrijorări cu privire la inconsecvența și natura particulară a unor politici. Cei care conțin conținut sexual, de exemplu, se spune că sunt cei mai complexi și confuzi.

Ca un singur exemplu minuscul de conținut pe care Facebook îl moderează, articolele notează: „Un document spune că Facebook analizează mai mult de 6,5 milioane de rapoarte pe săptămână referitoare la conturi potențial false - cunoscute sub numele de FNRP (fals, nu persoană reală)”. Și asta este doar pentru conturile false. Imaginați-vă câte milioane mai sunt rapoarte pentru conținutul real.

Caracteristici înainte de gândire

Înainte de a se lua în considerare modul în care oamenii ar putea folosi (și abuza) o nouă caracteristică, Facebook pare să fie în favoarea desfășurării lucrurilor și să afle cum să o modereze ca o gândire ulterioară. Uită-te la Facebook Live, un serviciu de streaming video care permite oamenilor să înregistreze orice se întâmplă în viața lor în acest moment. Pentru ce credeau că oamenii îl vor folosi în cele din urmă?

Acest lucru arată o lipsă consecventă de gândire a problemelor și abordarea proactivă a acestora înainte de a apărea. Sau greșind din partea „Hei, hai să rostogolim cu asta și să vedem ce fel de strigăte primesc înainte să facem ceva în legătură cu asta”. (Toate în numele „libertății de exprimare”, desigur, ignorând faptul că Facebook este o platformă globală.) 1

Unde am pus din nou acea linie directoare de moderare?

Și poate le puneți pe toate într-un singur manual? Deci, moderatorii știu unde să caute și fiecare orientare trebuie să fie consecventă?

Videoclipurile de auto-vătămare sunt perfect în lumea Facebook, deoarece persoana respectivă este „în primejdie”. La fel este și cruzimea față de animale (poate pentru că animalul este în primejdie?). „Răzbunarea porno” este, de asemenea, în regulă, dacă moderatorul nu poate confirma lipsa consimțământului ambelor părți (ceea ce, îmi imaginez, ar putea fi destul de greu de realizat în timp util).

„Unele fotografii cu abuz fizic non-sexual și agresiunea copiilor nu trebuie șterse sau„ acționate ”decât dacă există un element sadic sau de sărbătoare.” Atâta timp cât păstrezi sadismul și sărbătorile din imaginile și videoclipurile tale violente, aparent Facebook le va permite.

Potrivit documentelor, „Videoclipurile cu decese violente sunt deranjante, dar pot contribui la creșterea gradului de conștientizare. Pentru videoclipuri, credem că minorii au nevoie de protecție, iar adulții au de ales. Marcăm videoclipuri „tulburătoare” ale morților violente ale oamenilor. ” Nu este clar unde se încadrează conținutul sinucigaș - cum ar fi videoclipuri live sau amenințări - în politicile de moderare ale Facebook, dar pare a fi permis.

Facebook trebuie să acorde prioritate siguranței utilizatorilor

Unii au solicitat ca Facebook să fie reglementat mai puternic, deoarece este gatekeeperul întregului conținut (la fel ca un post de televiziune care este gatekeeperul conținutului din rețeaua sa):

Un raport al deputaților britanici publicat la 1 mai a spus că „cele mai mari și mai bogate companii de social media sunt rușinos de departe de a lua măsuri suficiente pentru a aborda conținutul ilegal sau periculos, pentru a implementa standarde comunitare adecvate sau pentru a-și păstra utilizatorii în siguranță”.

Erring din partea „libertății de exprimare” poate părea o idee bună, mai ales pentru o companie americană. Dar rețelele sociale sunt în primul rând comunități online - nu seamănă prea mult cu ziarele. Scopul principal al Facebook este de a conecta oamenii între ei. Rezultă că orientările lor ar reflecta mai mult această diversitate și sunt concepute pentru siguranța acelei comunități, mai degrabă decât un fel de mantră de publicare a știrilor sau ideologie goală.

Am dori să vedem Facebook să fie mai transparent cu privire la modul în care moderează milioane de oameni și conținuturi în fiecare zi. Aruncarea unei lumini mai mari asupra acestor probleme ajută la evidențierea problemelor și oferă Facebook posibilitatea de a îmbunătăți siguranța comunității sale. Și ne-ar plăcea să vedem Facebook arând mult mai mult din veniturile sale pentru a ne asigura că are suficient personal pentru a-și păstra platforma în siguranță. Pentru toți utilizatorii.

Pentru mai multe informații

Note de subsol:

- A, și rețineți că dacă mai aveți 100.000 de adepți pe Facebook, în ochii lor, acest lucru vă face o „persoană publică” - și nu vă supuneți confidențialității sau altor protecții ale oamenilor obișnuiți. [↩]